当前位置: 首页 > YYVIP易游技术文档

当前位置: 首页 > YYVIP易游技术文档

更新时间:2026-04-21

更新时间:2026-04-21 点击次数:

点击次数:

这项由天津大学计算机视觉团队完成的研究,以预印本形式发布于2026年4月,论文编号为arXiv:2604.08172,有兴趣深入了解的读者可以通过该编号查询完整论文。

手机修图软件、相机降噪功能、视频去雾处理……这些每天都在默默运行的AI图像处理技术,背后都有一套共同的训练逻辑:给AI看大量坏图片和好图片的对比,让它学会把坏的变成好的。听起来很直接,对吧?

但天津大学的研究团队发现,这套看似简单的训练方式藏着一个让人头疼的隐患——训练数据里的好图片和坏图片之间,经常存在一种与图像内容毫无关系的全局色彩差异,就好像拍摄时换了一盏灯泡,整张照片的色调悄悄发生了偏移。这种偏移与图像该不该去雾、该不该降噪根本没有关系,却悄无声息地混入了AI的学习过程,占用了大量的学习精力。

更麻烦的是,每一对图片的这种偏移方向和程度都不一样。一对照片的好版本整体偏暖,另一对照片的好版本整体偏冷,AI学着学着就被这些互相矛盾的信号搞糊涂了,白白浪费了大量训练资源,却没能真正学好该学的东西——如何还原图像的细节和纹理。

研究团队为这个问题设计了一个精巧的解决方案,起名叫光度对齐损失(Photometric Alignment Loss,简称PAL)。在跨越6类图像处理任务、16个数据集、16种神经网络架构的大规模测试中,PAL几乎在所有情况下都让AI的图像处理质量得到了提升,平均图像质量分数(PSNR)提高了0.45分贝。这个数字听起来小,但在图像处理领域已经是相当显著的进步了。

假设你要训练一个厨师,教他把盐放少了的菜改成调味恰当的菜。你准备了100对菜肴——原版(盐少的)和改进版(调味好的)。但问题来了:这100对菜肴是在不同时间、不同光线下拍摄的,有些照片整体偏黄,有些偏蓝,有些偏暗,有些偏亮。这些颜色偏差跟盐放多少根本没有关系,是拍摄环境造成的。

如果你直接告诉厨师:你做的和目标差在这里,你做的和目标差在这里,厨师会发现:有时候需要往更黄的方向努力,有时候需要往更蓝的方向努力,有时候往更亮的方向……这些指令互相矛盾,厨师大部分精力都花在试图弄清楚到底该偏哪个颜色上,真正应该学习的怎么调盐反而被忽视了。

研究团队通过大量数据分析证实了这个问题的普遍性。他们检查了两个典型数据集——专为低光增强(让暗照片变亮)设计的LOLv2-Real数据集,以及专为去雾设计的RESIDE-SOTS数据集——发现每一对训练图片的输入和目标之间,颜色通道的均值分布非常散乱,根本不在任何一条整齐的线上。换句话说,每对照片都有自己独特的颜色偏差方向,而且红、绿、蓝三个通道的偏差各不相同,情况相当复杂。

这种颜色偏差来自两个不同的源头。第一种叫任务内在型——对于低光增强、水下图像增强这类任务,目标图片本来就比输入图片亮得多、颜色鲜艳得多,这是任务的本质决定的。但问题是不同照片需要的提亮幅度和颜色方向各不相同,AI根本无法学到一个统一的规律。第二种叫采集诱发型——对于去雾、去雨这类任务,理论上目标图片和输入图片应该只有雾或雨的差别,颜色不应该变。但现实中,拍摄有雾照片和拍摄无雾照片时,相机的曝光设置、白平衡设置可能有微小差异,导致两张照片除了雾的有无之外还有细微的颜色偏差。

研究团队不仅发现了这个现象,还从数学上严格证明了它为什么会如此严重地干扰训练。

当AI做出一张预测图片,我们把它和目标图片逐像素相减,得到一个误差图。这个误差图可以被精确地分解成两个完全独立、互不干扰的部分:一部分是颜色偏移误差(整幅图像整体偏亮、偏暗、偏某种颜色),另一部分是内容结构误差(图像细节、纹理、边缘的差异)。这两部分在数学上是正交的,就好像水平方向和垂直方向是完全独立的两个维度一样。

关键的问题出在这里:颜色偏移是空间密集型错误——它在图像的每一个像素上都有体现,全图每个角落都受影响。而内容结构误差是空间稀疏型错误——它主要集中在边缘、纹理、细节这些局部区域,平滑区域几乎为零。

用图像尺寸来类比:一张100万像素的照片,颜色偏移误差会在100万个像素上都产生梯度信号;而内容结构误差可能只在其中的1万个像素(边缘和细节处)产生梯度信号。两者相比,颜色偏移误差产生的训练信号强度是内容结构误差的100倍!

研究团队用一个叫Retinexformer的神经网络做了实际验证:在整个训练过程中,颜色偏移误差占总梯度能量的比例高达70%甚至更高,而内容结构误差——也就是真正决定图像质量的那部分——只占不到30%。AI在训练过程中,大部分时间都在努力纠正那个根本不需要学的颜色偏移,内容细节的学习反而被严重压缩了。

这个比喻可以帮助理解:就像一个努力练习钢琴的学生,每次练习时老师给的纠正中有70%是在说你的坐姿今天和昨天不一样(每次都不同的坐姿问题),只有30%在说这个音符弹错了(真正需要改进的技术问题)。学生把大量精力花在反复调整坐姿上,真正的弹奏技术却没得到充分练习。

在设计解决方案之前,研究团队做了一个重要的判断:应该用多复杂的数学工具来描述和消除这种颜色偏差?

最简单的办法是用一个数字来缩放整张图片的亮度——业内叫做GT-Mean方法,就是算出目标图片和预测图片的平均亮度之比,然后按这个比例缩放预测图片。这只需要一个参数,非常简单。但研究团队通过对比实验发现,这种方法只能修正整体亮度,对于红绿蓝三个通道各自偏差不同的情况(比如照片整体偏红、白平衡问题导致的颜色偏移)完全无能为力。

再复杂一点的是对角矩阵方法,给红、绿、蓝三个通道分别用一个独立的缩放系数,共3个参数。这能处理各通道独立的曝光差异,但还是无法处理通道之间的耦合——比如白平衡校正时,红色通道的亮度会影响蓝色通道应该调整的量,这种跨通道的相互影响需要更复杂的模型才能捕捉。

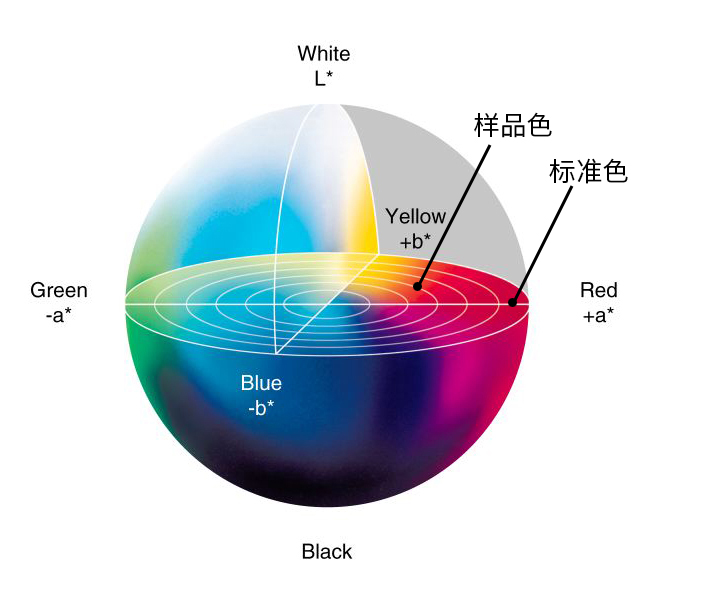

研究团队通过分析真实的颜色科学规律得出结论:真实世界的颜色偏差,包括白平衡偏移、色温变化、曝光差异等,需要一个完整的3×3矩阵加3维偏移量来精确描述,总共12个参数。3×3矩阵的9个参数负责描述通道之间的耦合关系(比如白平衡导致的红色成分影响蓝色通道),3个偏移量参数描述每个颜色通道的整体加减偏移(比如黑场偏移)。

在真实低光照片对上的可视化对比清楚地展示了这一点:只用亮度均值校正(1个参数),照片颜色依然明显偏冷;用对角矩阵(3个参数),颜色差异减小了但还是不对;只有完整的仿射变换(12个参数)才能让校正后的图像真正接近目标颜色。

理解了颜色偏差的本质,PAL的设计思路其实非常直观,像是给AI的训练过程加了一道颜色预处理。

每次计算训练误差时,PAL不是直接拿AI预测的图片和目标图片逐像素相减,而是先做一步:找出能让预测图片颜色最接近目标图片的那个仿射变换(12参数的颜色校正),然后对预测图片应用这个颜色校正,得到一张颜色对齐后的图片,最后再用这张颜色对齐后的图片和目标图片比较,计算误差。

这样一来,颜色偏移的部分被提前消除了,剩下的误差基本就是真正的内容结构差异——边缘不对、纹理没有、细节丢失……而这些才是AI应该重点学习的东西。

这个颜色校正变换的求解过程完全是数学上闭合形式的,不需要任何迭代优化,只需要计算预测图片和目标图片各自的统计特征(均值和协方差矩阵),然后做一次简单的矩阵求逆就能得到最优的12个参数。在256×256像素的图片上,这个计算只消耗0.0037 GFLOPs,是整个神经网络计算量的0.01%到0.1%,完全可以忽略不计。

还有一个重要的工程细节:在反向传播(AI更新参数的过程)时,这12个颜色校正参数是被冻结的,不允许梯度流过它们。这是因为如果允许AI通过调整这12个参数来降低损失,AI就会学会一个作弊技巧——把所有颜色都对齐好,让损失函数看起来很小,但实际上什么内容细节都没学到。冻结颜色校正参数,就是堵住这个作弊通道,确保AI必须真实地改善图像内容质量。

训练时,PAL和原有的像素误差损失函数一起使用,通过一个叫α的系数来平衡两者的权重。实验发现,对于图像增强任务,α取0.6效果最好;对于图像复原任务(不应该有颜色变化的那类),α取0.8更合适。

对于数值稳定性,PAL还引入了一个小小的正则化项(用ε=0.001的单位矩阵修正协方差矩阵),防止在图像颜色单调(例如大片白域)时矩阵求逆出现数值爆炸的问题。实验证明,ε太小(0.0001)会导致训练时出现NaN(数值崩溃)错误,ε太大则会让颜色校正效果下降,0.001是最佳折中。

研究团队对PAL进行了异常全面的测试,覆盖了图像处理领域的六大类主要任务。

**低光图像增强**是测试的重头戏。在LOLv1、LOLv2-real、LOLv2-synthetic三个标准数据集上,研究团队分别用了四种架构差异很大的神经网络进行测试。其中,基于Retinex理论(一种模仿人眼感知的数学框架)的Retinexformer网络获益最大:在LOLv1数据集上PSNR提升了1.13分贝,在LOLv2-real上提升了1.04分贝。研究团队分析,Retinex方法本身对光度不确定性特别敏感,因此从PAL的颜色对齐中获益更多。另外三种网络(MIRNet、Uformer、CIDNet)也都获得了稳定的提升,覆盖了PSNR、SSIM(结构相似度)、LPIPS(感知距离)等多个评价指标。

值得注意的是,这里还做了一个直接的横向比较:用GT-Mean方法(只校正整体亮度)和PAL(完整12参数颜色校正)对同样的网络进行对比。结果显示,PAL在所有网络和所有数据集上都优于GT-Mean,差距在0.20到0.86分贝之间。更有趣的是,GT-Mean在CIDNet网络上的LOLv1测试中居然让PSNR从23.97下降到了23.72,出现了负向影响,而PAL对CIDNet的提升则是稳定的。研究团队的解释是,GT-Mean的加性校正方式和CIDNet特有的可学习颜色空间产生了干扰,而PAL的设计避免了这类问题。

**水下图像增强**方面,在EUVP数据集上测试了三种专为水下设计的网络,全部获得提升:LiteEnhanceNet提升0.57分贝,Shallow-UWnet提升0.65分贝,Boths提升0.17分贝。水下图像增强特别适合PAL,因为水下光线的衰减在不同波长(颜色)上差异极大,红光衰减最快,不同水质、不同深度的衰减情况各异,导致训练对之间颜色偏差的方向和幅度极为分散——正是PAL最擅长处理的场景。

**夜间去雾**是PAL表现最为突出的场景之一。在NHR数据集上,NAFNet网络提升了0.85分贝,Restormer网络提升了0.59分贝,LPIPS(感知质量)也有明显改善。夜间去雾的数据采集环境极其复杂,人工光源、散射光的颜色偏移极为严重,导致训练数据中的颜色不一致性特别强烈,这使得PAL的效果格外明显。

**全天候图像复原**(将去雨、去雪、去雾、去雨滴整合到一个模型中)是对PAL的一个额外挑战,因为不同天气类型的数据本身就来自不同数据集,颜色特性各异,混合训练时颜色不一致性会进一步加剧。测试结果显示,Histoformer和MODEM两种网络在Snow100K-S、Snow100K-L、Outdoor、RainDrop四个子数据集上大多数指标都有提升,证明PAL能够同时应对同一对内部的颜色不一致和不同数据集之间的颜色不一致两种来源。

阴影消除任务是一个特别有趣的特殊案例,因为它在同一张图片内部同时存在两种完全不同的颜色处理需求:阴影区域需要做颜色还原(把被遮挡变暗的地方恢复正常颜色),非阴影区域应该保持颜色不变(但实际拍摄时会有微小的采集误差)。

如果直接对整张图片用一个全局颜色校正,就会把阴影区域和非阴影区域的情况混为一谈,效果反而变差。研究团队对此设计了PAL的扩展版本:利用阴影分割掩码(阴影消除算法本来就会用到这个掩码,标记哪些区域是阴影),把图片分成阴影区域和非阴影区域,分别独立计算颜色校正矩阵。

这样就把一个复杂的混合问题拆分成两个相对简单的纯净问题:阴影区域的颜色校正捕捉应该有的颜色还原,非阴影区域的颜色校正捕捉不应该有但确实存在的采集误差,两者分别处理,互不干扰。

在ISTD数据集上,RASM网络提升了0.33分贝,HomoFormer网络提升了0.47分贝,而SSIM和RMSE(均方根误差)保持相当水平,没有出现质量下降的情况。

除了在测试集上的数值提升,研究团队还做了一个更有说服力的测试:跨数据集泛化能力。

具体做法是:用LOL数据集训练的模型,不经过任何调整,直接拿去处理完全不同来源的低光照片——包括DICM、LIME、MEF、NPE、VV五个独立数据集。这些数据集没有配对的参考图片,无法计算PSNR,只能用不参考原始图片的感知质量评分(IQA)和美学评分(IAA)来评判,使用的是Q-Align评分系统(一种基于大语言模型的图像质量评分工具)。

结果显示,在全部4种网络架构和全部5个跨域数据集上,加入PAL训练的模型都获得了更高的感知质量分数和美学分数。这说明PAL不只是让AI在它见过的数据上表现更好,更重要的是让AI学到了更真实的颜色复原能力,在面对陌生场景时也能产生更自然、更舒适的颜色。

这个发现背后的道理其实很直观:用标准训练方法训练的AI,把大量学习精力放在了记忆训练集的颜色偏向上(每个训练集都有自己独特的颜色风格)。换了新的数据,这些记忆来的颜色习惯反而成了障碍。而PAL把颜色偏移从训练信号中剥离出来,让AI真正学到的是如何还原图像内容而不是如何复现训练集的颜色风格,因此在新场景下反而更游刃有余。

研究团队对PAL的局限性保持了相当清醒的认识,在论文的附录中进行了坦诚的讨论。

PAL建模的是全局颜色偏移——整张图片用同一套12参数的颜色校正。对于局部的颜色不均匀(比如照片边缘暗角、局部光源导致的颜色渐变),PAL无法精确捕捉。不过研究团队指出,这其实是一个刻意的设计选择:全局模型不会把局部的纹理和边缘误认为颜色偏移而消除掉。实验结果也证实,在同时包含全局和局部降质的全天候任务上,PAL没有出现过度校正的问题,说明全局模型对局部内容的干扰确实很有限。未来可以探索分块仿射方法,把图片分成若干区域,每个区域独立估计一个颜色校正,在处理能力和安全性之间取得更好的平衡。

另一个局限是,真实相机的成像过程包含了Gamma校正、色调映射等非线性操作,而PAL的仿射模型是线性的,只是对这些非线性操作的一阶近似。好消息是,大多数平滑的非线性变换在局部都可以用线性(仿射)函数很好地近似,而且仿射模型12个参数的简洁性也防止了过拟合——如果参数太多,模型可能会把图像内容本身的颜色变化也吸收进去,造成内容信息的损失。

说到底,这项研究做的事情看起来很简单——在计算训练误差之前,先把颜色偏差校正掉。但正是这个简单的操作,让AI图像处理训练中长期被忽视的颜色干扰问题得到了明确的解决。训练数据里那些由于拍摄条件不同造成的颜色差异,就像是一种慢性干扰,AI每天都在为这些它永远学不对的矛盾信号花冤枉力气。PAL做的就是在训练开始前先跟AI说:这些颜色偏差你不用管,我帮你处理掉,你只需要专心学怎么把图像细节还原好。

这个思路对未来图像处理AI的训练有普遍的参考价值。只要涉及配对训练数据,只要数据采集条件不是绝对统一的(而现实中几乎不可能绝对统一),这种颜色偏差干扰就会存在。更有趣的是,研究团队在理论层面证明了,在L1损失函数(一种常用的另一种训练损失)下这个问题甚至比L2损失下更严重,因为L1对每个像素的误差权重相同,颜色偏移的密集覆盖效应会更彻底地压制内容误差的信号。

有兴趣了解技术细节的读者,可以通过arXiv编号2604.08172查阅这篇天津大学团队的完整论文,其中包含完整的数学推导和PyTorch代码实现。

Q1:PAL方法和传统的GT-Mean颜色校正方法相比,具体有什么区别?

A:GT-Mean只用一个数字对整张图片的亮度做缩放,所有颜色通道用同一个系数,无法处理红绿蓝各通道偏差不同的情况,也无法处理通道之间的耦合(比如白平衡问题)。PAL用一个12参数的数学模型(3×3矩阵加3维偏移),能同时捕捉三个颜色通道各自的增益差异、通道间的耦合关系以及整体的颜色偏移。实验证明,即使在GT-Mean最擅长的低光增强任务上,PAL的效果也普遍优于GT-Mean,差距在0.20到0.86分贝之间,而且GT-Mean在某些网络上还会造成性能下降。

A:几乎可以忽略不计。在256×256分辨率的图片上,PAL额外的计算量约为0.0037 GFLOPs,相当于整个神经网络前向计算量的0.01%到0.1%。核心操作只是计算图片的统计特征(均值和协方差矩阵)然后做一次小矩阵求逆,不需要任何额外的神经网络模块或可学习参数。

A:效果有限甚至没有效果,但这是预期之内的情况。对于超分辨率和高斯去噪任务,目标图片和输入图片的颜色本来就应该几乎完全一致,训练对之间几乎没有颜色偏差。在这种情况下,PAL估计出的颜色校正矩阵会自动收敛到接近单位矩阵(不做任何变换),PAL损失自然退化为普通的像素级误差损失,不产生负面影响但也没有额外收益。PAL的价值主要体现在训练数据存在明显颜色不一致性的任务上。

特别声明:以上内容(如有图片或视频亦包括在内)为自媒体平台“网易号”用户上传并发布,本平台仅提供信息存储服务。

DPOY冤案?场均13板3帽,连续3年防守效率联盟第1!巅峰赛季0选票

追到1-1!华子30+10森林狼19分逆转掘金 约基奇24+15+8穆雷30分

拒绝“堆料”内卷 华为乾崑死磕安全底线 华为乾崑奕境首款旗舰大六座SUV定名X9

全球首发哈苏10倍天眼长焦!OPPO Find X9 Ultra发布:7499元起